美团发布革命性TTS技术,音色克隆新突破!

创始人

2026-04-02 16:38:13

0次

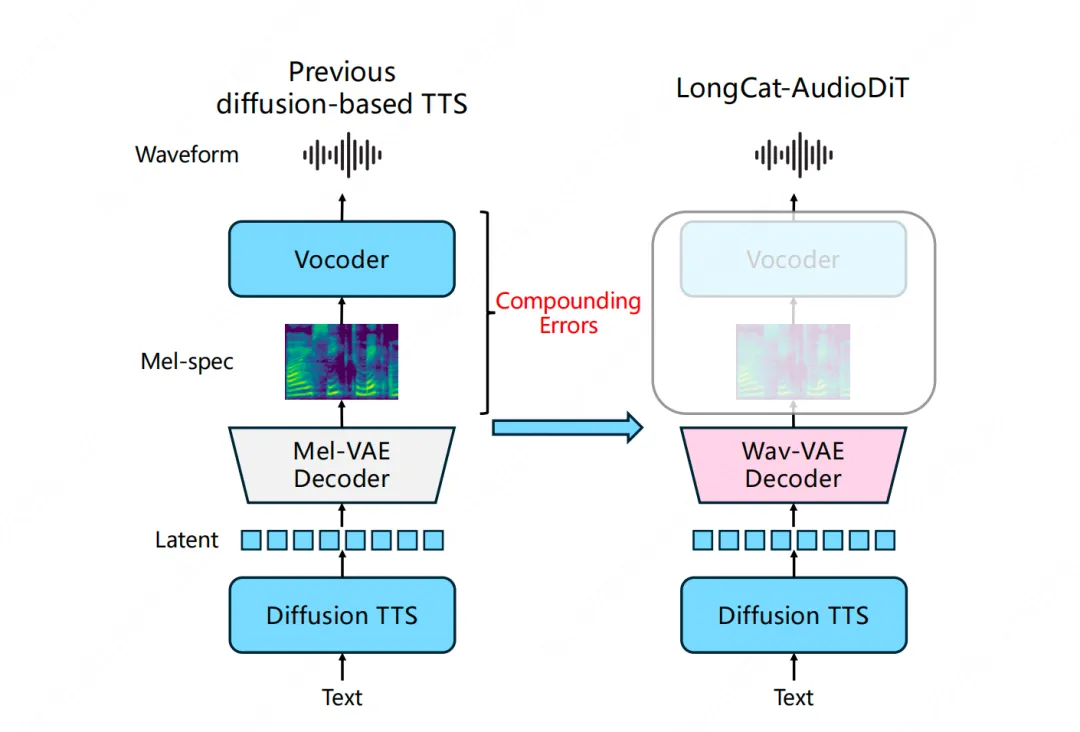

4月2日,美团对外发布了一款名为LongCat-AudioDiT的音频生成模型,该模型在文本转语音(TTS)领域实现了技术突破,直接在波形潜空间进行基于扩散模型的转换,摒弃了传统的梅尔谱等中间表示。这一创新减少了在不同空间转换过程中累积的误差,提升了合成声音的高保真度和个性化细节。

LongCat-AudioDiT的核心架构包括一个波形变分自编码器(Wav-VAE)和一个扩散Transformer(DiT),在波形隐空间内完成声音的压缩、建模与重建。该模型采用了高效的下采样与多尺度建模、非参数捷径稳定训练以及对抗式多目标训练等创新技术。其骨干网络基于Transformer,并集成了全局自适应层归一化(GlobalAdaLN)、QK-Norm+RoPE稳定注意力训练等多项结构优化,有效修复了流匹配TTS的“训练-推理”不匹配问题。

在性能测试方面,LongCat-AudioDiT的3.5B版本在Seed-ZH测试集的说话人相似度(SIM)指标达到了0.818,Seed-Hard测试集达到0.797,超越了Seed-TTS、CosyVoice3.5、MiniMax-Speech等知名模型。目前,LongCat-AudioDiT模型已经开源,相关论文和代码可通过链接访问。

相关内容

热门资讯

特朗普自行宣称对伊朗战事取得“...

美国总统特朗普发表讲话,自行宣称对伊朗战事取得“快速、决定性、压倒性胜利”。来源 | 新华社

看见2030 “十五五”新图景...

“十五五”规划纲要提出,要建设海上风电基地。在广东阳江,这座粤西小城,坐落着国内规模最大的海上风电装...

“投资于人”,这些认识误区要纠...

当前,“坚持投资于物和投资于人紧密结合”日益成为共识,各地各部门在谋划推进中更加注重彰显“人”的维度...

苦难和新生——西藏翻身农奴影像...

1959年3月28日,国务院颁布命令,在西藏施行民主改革,彻底废除“政教合一”的封建农奴制。从此,西...

肯尼亚媒体:中国零关税举措为非...

肯尼亚多家主流媒体日前刊文表示,中国将于2026年5月1日起对53个非洲建交国全面实施零关税举措,充...

广货行天下丨每出口9辆摩托就有...

“广州摩托”已成为广州制造走向世界的闪亮名片。近日,张雪机车在世界超级摩托车锦标赛(WSBK)葡萄牙...

清明祭扫高峰期,广州部分路段将...

清明假期将至。4月2日,记者从广州交警获悉,此次假期广州出城高峰将出现在3日下午和4日上午,返程高峰...

“零等待”“零延时”!中山边检...

3月31日19时,满载中山生产的空调、微波炉等家电的“珠船2006”号船舶,经珠海边检总站中山边检站...

晴雨即将转换!今晚广东暴雨或重...

假期在即,你是否准备好了出门走一走?派派君在这里提醒,天气要变得复杂起来了……昨天是个大晴天,“流浪...

【视频】首尔?广州!这张绝美风...

近日,一张定格广州黄埔区科学城街景的异木棉照片在海外社交平台意外走红,粉色花簇与缓缓驶过的公交车相映...