阿里通义实验室发布语音生成新模型,自然语言指令生成语音成现实

创始人

2026-03-02 11:31:44

0次

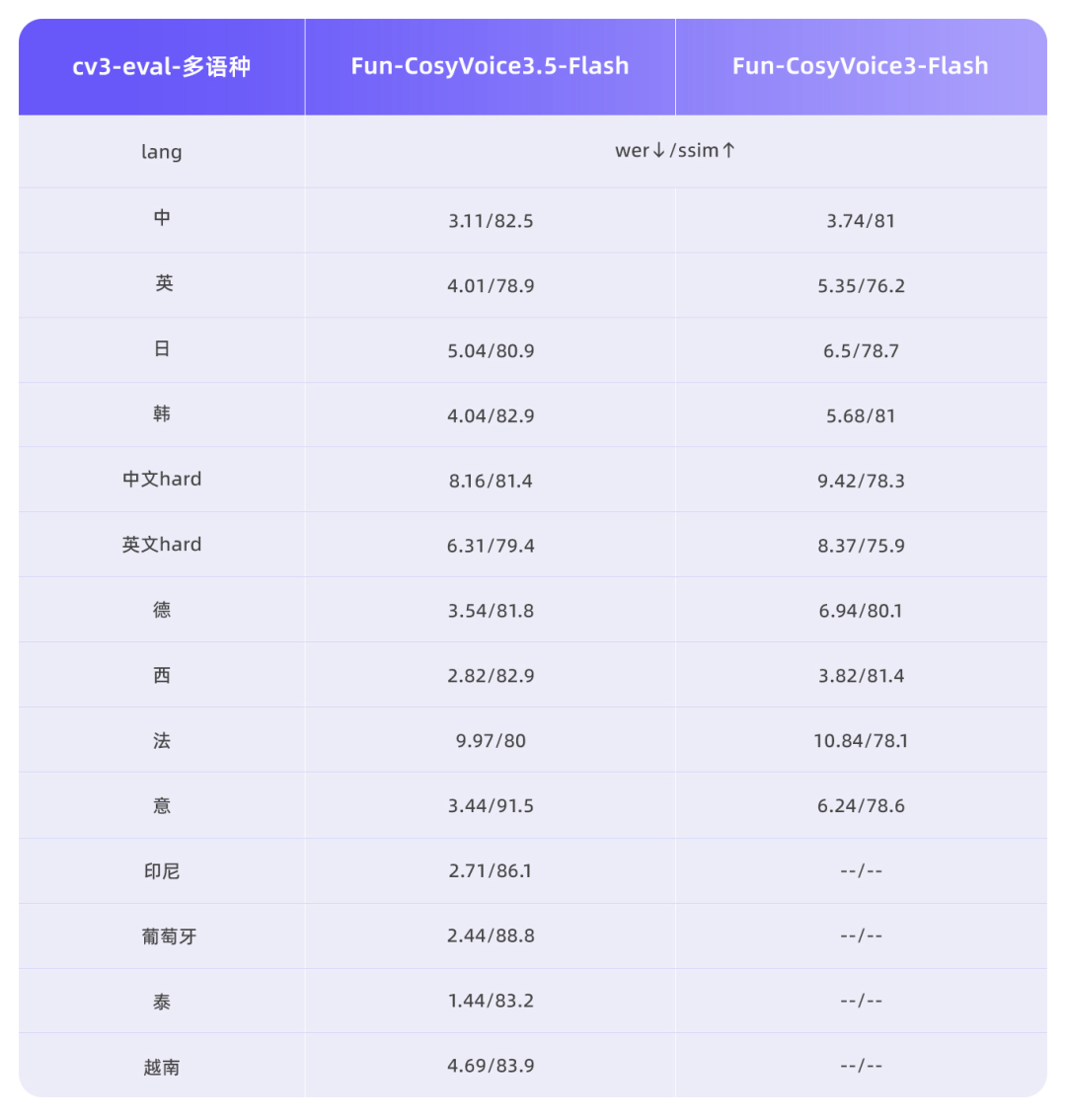

3月2日,阿里通义实验室语音团队发布了两款新型语音生成模型Fun-CosyVoice3.5与Fun-AudioGen-VD,这两款模型均支持通过自然语言指令控制语音生成,但各自应用方向不同。Fun-CosyVoice3.5模型在Instruct-TTS方向实现能力升级,支持FreeStyle指令控制生成效果,用户可以用自然语言描述表达方式,模型即可理解并生成相应表达。该模型新增支持泰语、印尼语、葡萄牙语、越南语,并在13种语言的WER和SpkSim客观指标上保持业内领先。针对生僻字、复杂语句等容易读错的场景专项优化,生僻字读错率显著降低。性能方面,Tokenizer帧率减半,首包延迟降低35%,提升了实时交互场景下的响应速度和流畅度。

Fun-AudioGen-VD模型则支持根据自然语言描述生成目标音色、情绪表达和完整听觉场景,实现“人物+场景”的一体化声音生成。该模型能够根据基础属性、音质特征、情绪表达和角色模拟等生成声音,并能叠加背景环境音、模拟空间混响效果、还原设备听感滤镜以及支持动态环境互动,打造沉浸式听觉场景。

相关内容

热门资讯

长城V9X全球首秀!东方美学S...

3月7日,长城汽车宣布,魏牌V9X造型美学全球首秀直播将于3月9日18:00-19:00举行。长城汽...

莲花ForMe插混超跑3月10...

3月7日,莲花跑车宣布其全新车型莲花ForMe将于3月10日开启小订,并于3月29日正式上市。新车搭...

比亚迪腾势Z9GT震撼上市:1...

3月7日,比亚迪宣布全新腾势Z9GT首批展车已陆续抵达全国14个城市。这款新车搭载了比亚迪第二代刀片...

特斯拉加州超级充电站将扩建至4...

3月7日,特斯拉计划在加州建设迄今为止规模最大的超级充电站。该公司已提交规划,拟在加州Yermo的E...

雷军警告:智能驾驶睡觉危险,呼...

近日,全国人大代表、小米集团创始人雷军在接受中国新闻周刊采访时强调了智能辅助驾驶功能使用时的安全问题...

经济大省挑大梁!2025年广东...

3月6日下午,在十四届全国人大四次会议广东代表团开放日上,广东省委常委,省政府党组副书记、常务副省长...

中国经济的“榫卯”之韧丨喻见中...

榫卯结构,榫凸卯凹,精准咬合,双向赋能,是我国传承千年的建筑智慧。中国经济也藏着这样的“榫卯”结构,...

聊会·开局怎么干|扎实推进乡村...

今年两会,“扎实推进乡村全面振兴”写进了2026年政府工作报告中。“十五五”开局之年,乡村如何强、如...

世说中国 | 埃塞俄比亚资深议...

三月初,全国两会如期而至,世界再度将目光投向北京。值此盛会,新华网推出“外国议会人士看两会”系列访谈...